När magin blir infrastruktur: Största förändringen du inte visste om

Den största förändringen i AI-industrin som ingen pratar högt om

Konsument-chattbotarna har haft sin tid i rampljuset. Nu vänder blicken mot något betydligt större: tung infrastruktur för autonom drift. Under den senaste veckan i april 2026 har Anthropic, OpenAI, Google, Mistral och Manus alla släppt interna dokument som avslöjar en gemensam strategi — att förvandla AI från underhållning till kritisk företagsinfrastruktur.

Det här är inte hype. Det är ritningarna till nästa industriella revolution.

När magin blir infrastruktur

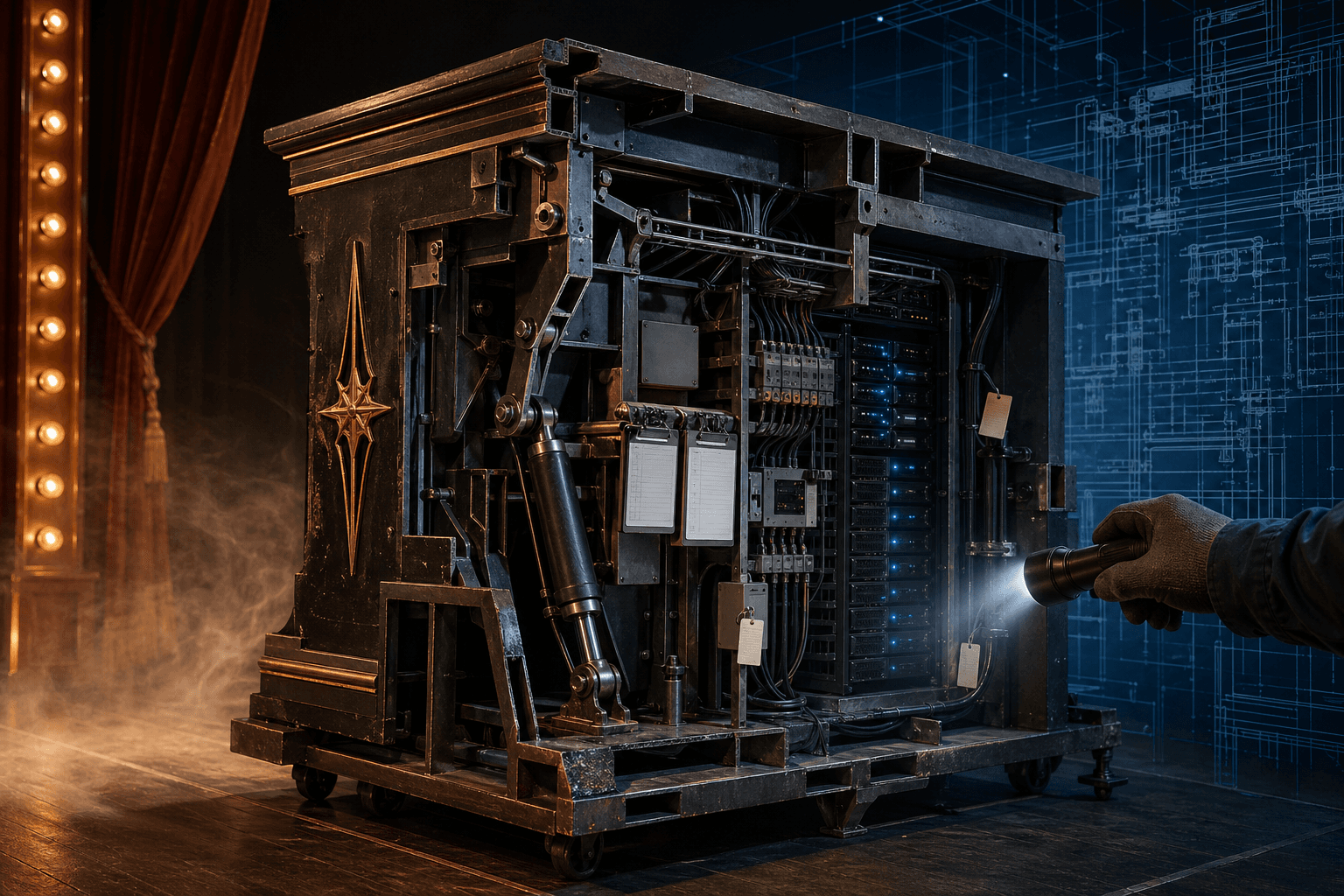

När du först ser en magiker såga någon i två delar är det ren magi — rök, speglar, dramatisk musik. Du tänker inte på de dolda gångjärnen på lådan. Du vill bara se tricket.

Men föreställ dig att samma magiker plötsligt anlitas för att konstruera stålstommen till en 70-våningars skyskrapa. Då vill du inte ha rök och speglar. Du vill ha absolut tråkig tillförlitlighet. Du vill inspektera ritningarna, verifiera svetsfogarna. Magin måste bli infrastruktur.

Det är exakt den övergång som pågår inom AI-industrin just nu. Konsumentmagin tar bakstånd — och ersätts av tung industriell fastighetsautomation. Här är vad vi lärde oss av interna källor från den sista veckan i april 2026.

🔍 Anthropic — transparens som valuta

Anthropic publicerade nyligen en ovanligt ärlig teknisk postmortem om sin kodningsagent Claude Code. Istället för att sticka huvudet i sanden erkände de öppet att agenten lidit av kraftig kvalitetsförsämring.

Tre specifika buggar lades fram:

- Förhastad resonemang: De hade tvingat agenten till "medel" resonemangsnivå för att spara latency — de tvingade AI:n att skynda på läxan

- Amnesia-buggen: En kontextrensning som fungerade felaktigt raderade agentens minne vid varje konversationsturnus

- Brevitetsregeln: De begränsade utdata till 25 ord mellan verktygsanrop — vilket kvävde modellens arbetsminne

Anthropic rullade tillbaka alla ändringar. Och deras nästa drag var ännu mer intressant — de släppte uppdaterad hanterad agent-minne i publik beta.

Vad betyder 100 kB-gränsen?

Varje minnespost är hårt begränsat till 100 kB. Det tvingar utvecklare att bygga modulära filsystem istället för att dumpa hela kodbasen i kontexten — som att indexera ett bibliotek istället för att memorera varje bok.

Men med läs-skriv-minne kommer prompt-injektionsrisker. Om en otillförlitlig användare matar in skadlig kod och agenten sparar detta i sitt minne — återkallas det kommandot på alla framtida uppgifter, även för andra användare. Anthropic tvingar nu utvecklare att desinficera allt som skrivs till långsiktigt minne.

🧠 OpenAI — nervsystemet hårdas

OpenAI flyttar sina mest kraftfulla modeller djupt in i plånboken. GPT 5.5 och GPT 5.5 Pro har officiellt flyttat in i API:t — med en miljon tokens kontextfönster.

Skillnaden mellan chattgränssnitt och API är enorm:

- En modell isolerad i en konsumentchatt är som en racermotor på en provbänk — du kan inte bygga automatiserade affärsprocesser kring den

- När den flyttar till ett API med batch-bearbetning kan utvecklare programmatiskt dirigera tusentals kundserviceloggar till den klockan 03:00

OpenAI uppdaterade också GPT 5.5:s systemkort specifikt för API-säkerhet. Om en AI hallucinerar i ett chattfönster är det irriterande — via ett API kopplat direkt till din produktionsdatabas är det katastrofalt.

Unix Socket-transport är nyckeln här. Tänk på det som att skicka en vikt papperslapp under bordet till någon i samma rum — det når aldrig det publika internetet. Det är blixtsnabbt och extremt säkert, perfekt för backendsystem där AI-agenten och databasen bor på samma fysiska server.

Tillsammans med "sticky environments" — där nätverksanslutningen behåller AI:s arbetstillstånd vid avbrott — får utvecklare förutsägbarhet som aldrig förr. Codex rapporterar nu även reasoning-token-användning i JSON-utdata, så utvecklare exakt kan spåra vad AI:n kostar medan den tänker.

🏗️ Google — säkerhetsgrindar på baksidan, fest på framsidan

Google spelar båda sidorna just nu. De släppte Gemini Drop — en konsumentinriktad upplevelse med inbyggd Mac-åtkomst, bestående projektböcker och "personlig intelligens" som integreras djupt i ditt dagliga liv.

Men på utvecklarsidan råder en helt annan stämning. Säker miljöinläsning och strikt tillämpning av arbetsplatstillit i headless-läge.

Huvudlös lägesförklaring: Ett AI-agentprogram som körs utan grafiskt gränssnitt — ingen operatör som klickar "godkänn". Om en skadlig skript smyger in i arbetsområdet kan AI:n blint exekvera den. Googles nya tillitsupprätthållande pausar aktivt agenten och kräver kryptografisk verifiering av arbetskatalogen innan ett enda kommando tillåts.

Intressant nog exkluderas "personlig intelligens" aktivt i Europeiska ekonomiska samarbetsområdet, Storbritannien och Australien. Det är inte ett tekniskt fel — det är regulatoriska rälsen som håller produkten livskraftig. GDPR gör den typen av omgivande datainsamling till en absolut juridisk minfält.

🔑 Mistral — den automatiserade nyckelvakten

Om man låser in en AI-agent så hårt att den inte kan komma åt något utan en mänsklig handledare — hur får man den att göra riktigt arbete? Autentiseringsflaskhalsen är troligen den största friktionen inom företagsautomation just nu.

Den traditionella Oauth-protokollen är som en temporär nyckelvakt: Varje gång agenten försöker komma åt ett verktyg avbryts den — "ursäkta, jag behöver nyckeln igen." Det bryter hela konceptet med autonomi.

Mistrals nya Python SDK introducerade arbetsyta med en hjälpfunktion som heter "Execute with Connector Rothesync" — trots det klumpiga namnet är det ren elegans. När ett långt arbetsflöde träffar ett verktyg som kräver färsk autentisering pausar det arbetsflödet elegant, hanterar inloggningsåteruppringning i bakgrunden, hämtar den nya åtkomsttoken och återupptar agenten exakt där den slutade.

Dessutom utökade de promptcache-nycklar — vilket sparar massiva mängder beräkningskostnader när en agent analyserar tusentals dokument mot samma regeluppsättning.

🚀 Manus — från uppgifts-API till distributionsplattform

Manus genomgår en fascinerande evolution — de övergår från att vara ett enkelt uppgifts-API till en högt bestämd distributionsplattform.

Nya slutpunkter:

- Webbplatsutgivning — agenten kan bygga en sajtstruktur som utvecklare programmatiskt kan publicera

- Asynkron distribution — du måste poll:a statusändpunkten för att verifiera när driftsättningen är klar

- Endast senaste revision — du kan aldrig rulla tillbaka till en tidigare version via API:t

Det vildaste: Det finns ingen publik avpubliceringsändpunkt. Om du vill ta ner hela sajten kan du inte göra det via API:t — du måste maila supporten.

Varför? Programmatisk nedmontering är otroligt farlig. Om en autonom agent kan avpublicera en webbplats kan en lätt hallucination radera hela din produktionsföretagswebbsida klockan 02:00. Manus bygger säkerhet genom att kräva mänsklig tillsyn för de mest destruktiva åtgärderna.

Manus inför också strikta delade hastighetsbegränsningar — 10 dollar per minut för uppgiftsgenerering. Det är inte konsumentprissättning; det är industriell skalningsskydd. De vill inte att hobbyister spammar systemet och försämrar prestandan för företagskunder.

🔮 Vad betyder allt detta?

Vi spårar hela AI-agentens livscykel:

- Anthropic bygger transparens och hanterbart minne — bevisar att radikal ärlighet om buggar faktiskt bygger utvecklarförtroende

- OpenAI hårdar nervsystemet — flyttar sina mest kapabla modeller in i API:t och låser ner lokal serverkommunikation

- Google stängslar in utvecklarbakgården med strikt tillitsverifiering medan de navigerar globala datalagar

- Mistral agerar automatiserad nyckelvakt — jämnar ut smärtsamma behörighetsflaskhalsar

- Manus förvandlar agenter till fullstack-driftsatta webbansvariga med strikta säkerhetsbegränsningar

Tankar om hur detta påverkar framtiden

Magishowen är officiellt över och skyddshjälmen är på. AI-industrin växer verkligen upp.

Grundläggande lagret finns här. Vi rör oss äntligen mot en verklighet där AI-agenter pålitligt kan utföra komplexa flerstegsuppgifter över långa tidshorisonter utan att kräva konstant mänsklig barnvakt.

När agenterna oundvikligen börjar förhandla hastighetsbegränsningar, åtkomstnycklar och komplexa säkerhetsprotokoll direkt med varandras agenter — helt i bakgrunden — ställs den avgörande frågan:

När systemen vi byggde börjar skriva sina egna ritningar — vem inspekterar svetsfogarna?

Det är nästa eras definierande fråga.

Signa upp för vårt nyhetsbrev och få djupdykningar som denna direkt i din inkorg — så du inte missar nästa skifte innan resten av marknaden gör det.

Smedjans nyhetsbrev

Få nya artiklar i inkorgen

Välj de ämnen som intresserar dig. Inget brus, max ett mejl i veckan.

Vi följer GDPR. Avsluta när du vill.